谷歌“压缩革命”冲击AI算力逻辑:存储需求见顶了吗?

2026/03/26 11:09来源:第三方供稿

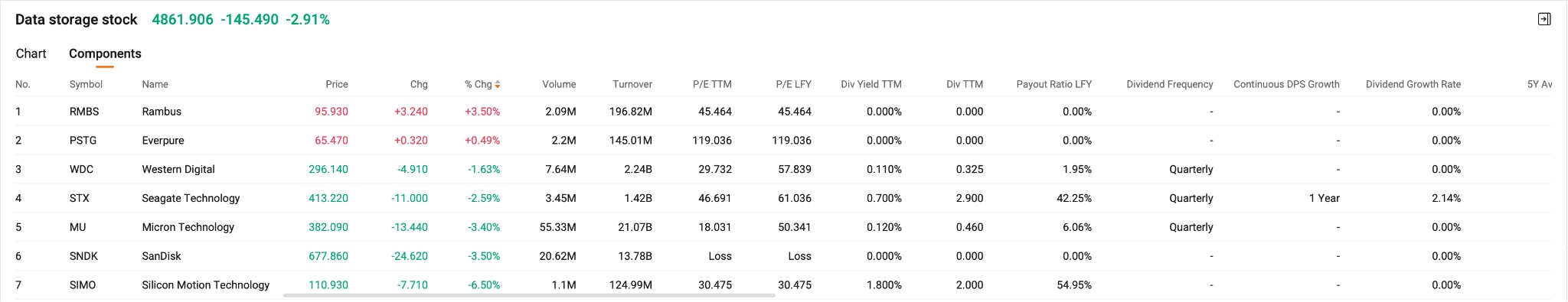

TradingKey - 谷歌(GOOGL)发布的新型AI内存压缩技术TurboQuant,引发市场对存储需求前景的担忧。受消息影响,美股存储芯片板块周三盘中遭遇重挫,闪迪(SNDK)一度跌6.5%,美光科技(MU)一度跌超5%,西部数据(WDC)一度跌超6%,希捷科技(STX)跌超8%。

在过去一年AI行情中,存储板块受益于HBM、DRAM与NAND价格上涨,估值已处于相对高位,因此任何潜在削弱需求增速的变量,都会被迅速定价。

据称,该技术可在不损失准确性的前提下,将大语言模型的缓存内存占用至少减少6倍,并实现最高8倍的加速,旨在解决AI推理与向量搜索中的内存瓶颈问题。

TurboQuant的核心在于对大模型推理阶段的内存占用进行极限压缩。在不显著损失模型精度的前提下,其可将KV Cache压缩至3比特,实现约6倍内存节省,并带来最高8倍的推理性能提升。

这一突破本质上并未削弱AI需求,而是显著提升了单位算力的使用效率,使得相同硬件资源能够承载更多推理任务。

市场定价显示,这一技术被解读为“存储利空”。

然而,从当前信息来看,该技术主要作用于推理环节,并未触及训练侧对高带宽内存的刚性依赖,也难以替代大规模算力集群在模型训练中的核心地位。这意味着,AI基础设施的需求基础仍然稳固,只是资源使用方式正在发生变化。

进一步来看,这种效率提升反而可能带来“需求扩张”的结果。当推理成本显著下降,AI应用的商业化门槛同步降低,更多企业与开发者将有能力部署大模型服务,终端使用频率也随之提升。在这一过程中,整体算力消耗未必下降,反而可能因应用场景扩展而上升。即效率提升在一定条件下会刺激总需求增长。

此次存储板块的回调,更像是高估值环境下的预期再定价,而非基本面松动,但长期来看,AI需求的扩散趋势并未改变,反而可能因成本下降而进一步强化。

谷歌TurboQuant所带来的冲击,本质上并非“需求消失”,而是“需求重构”。投资者需要关注的是,在AI效率持续提升的背景下,哪些存储公司能够在新的产业结构中把握原有的定价权。