英伟达GTC 2026全程高能:Vera Rubin、AI工厂、一键“养虾”……

2026/03/17 07:38来源:第三方供稿

每年让科技圈、投资圈集体沸腾的“AI届春晚”来了!

北京时间3月17日凌晨,英伟达年度开发者大会(GTC 2026)在加州圣何塞拉开帷幕,将持续至19日。

而最受期待的,莫过于黄仁勋主题演讲——那个常年穿皮夹克、一开口就带火一堆黑科技的“AI教父”,一出手便是王炸。

从3nm量产旗舰到1.6nm未来架构、从专用推理芯片到AI工厂、从开源智能体到太空算力……每个都可能是下一个万亿市场的入口。

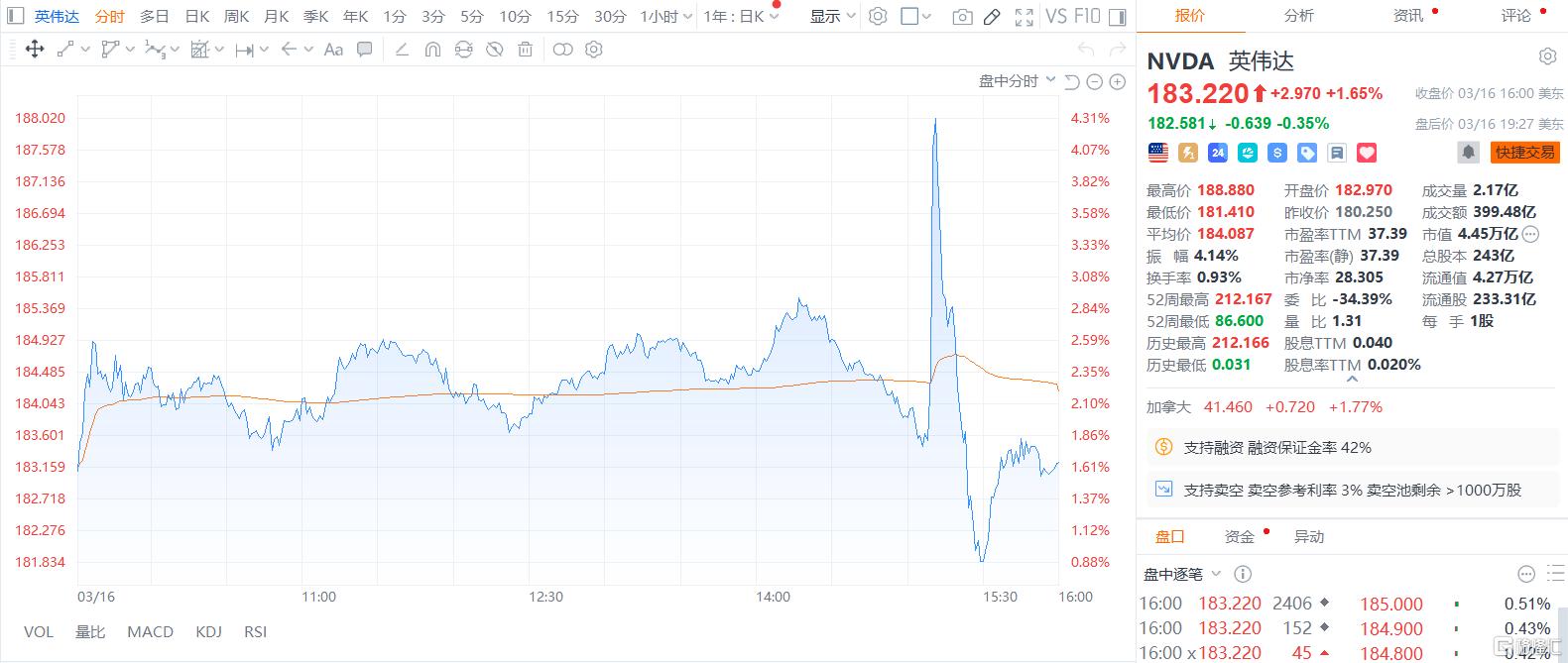

受消息影响,英伟达股价直接起飞,一度飙涨超3.3%,随后有所收窄,截至收盘涨1.65%,市值高达4.45万亿美元。

从芯片公司到1万亿美元“代币工厂”

黄仁勋在演讲中宣布,计算需求进入“百万倍增长”阶段,将今后至2027年这段时期的算力需求预测由5000亿美元翻倍至1万亿美元。

为什么需求会这么大?

“因为推理的转折点已经到来。”黄仁勋详细解释了原因。

而过去两年发生了什么?黄仁勋在演讲中回顾:

第一,ChatGPT开启了生成AI时代。

它不只是理解和感知,还能翻译和生成独特的内容。

第二,推理AI(o1/o3)出现了。

它能反思,能思考,能规划,能把一个无法理解的问题分解成能理解的步骤。这让ChatGPT真正起飞了。

第三,claude code出现了:第一个代理式模型。

它能读文件、写代码、编译、测试、评估、迭代。claude code彻底改变了软件工程。

过去两年,AI的计算需求增加了大约1万倍。

AI现在必须思考,为了思考、为了执行、为了阅读,它都必须推理。每一次交互,它都在推理。

过去的训练时代已经过去了,现在是推理的时代。

这就是1万亿美元需求的来源,每一个公司都在建设AI工厂,每一个工厂都需要Token生产。

黄仁勋定义了“代币工厂(Token Factory)”概念,指出未来的数据中心将不再是存储中心,而是生产智能代币的工厂。

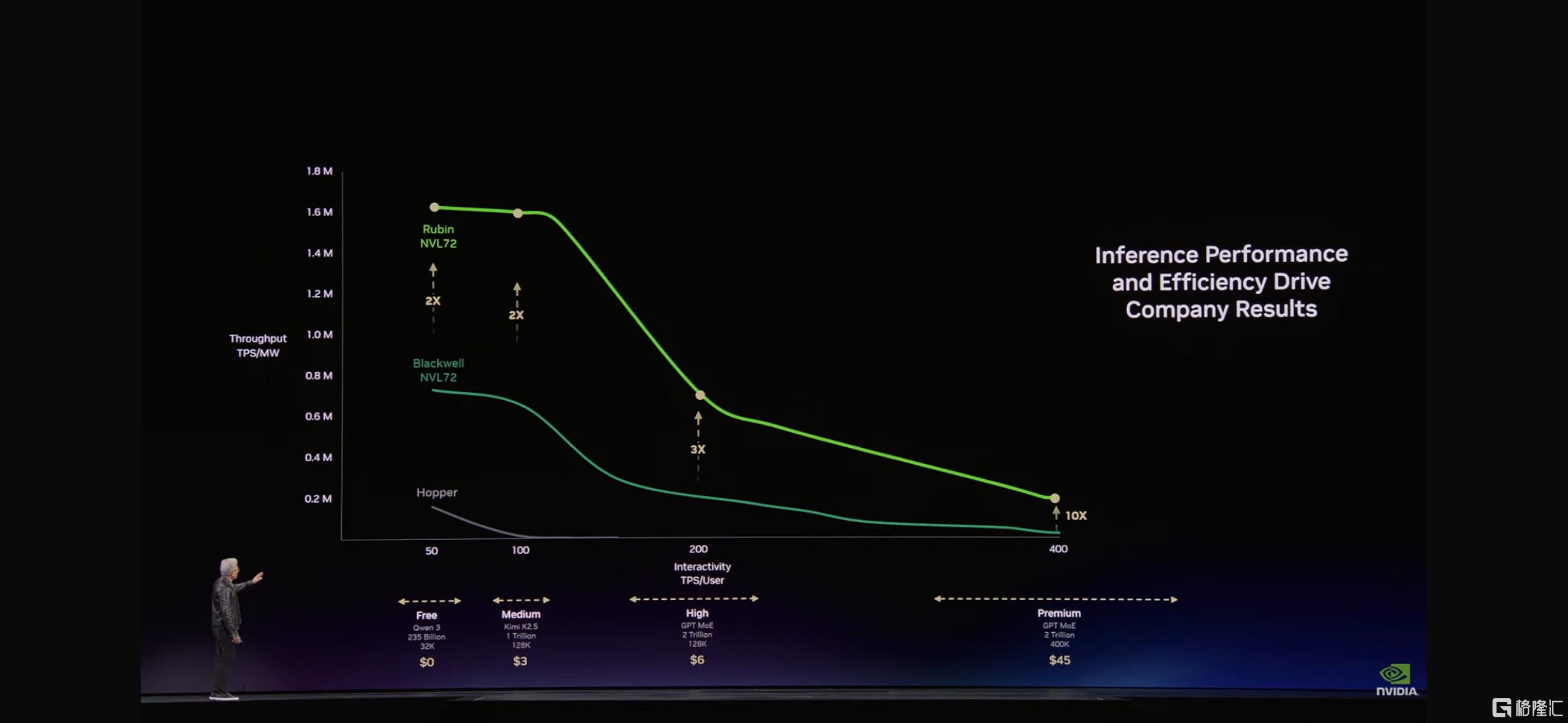

图表中,横轴是Token速率,纵轴是吞吐量。

这也将决定未来每一个CEO的决策——因为直接关系到AI工厂的营收。

就像任何行业一样,更高的质量,更高的性能,更低的容量。Grace Blackwell在你的免费层提升了巨大吞吐量,但在你最能变现的层级,它提升了35倍。

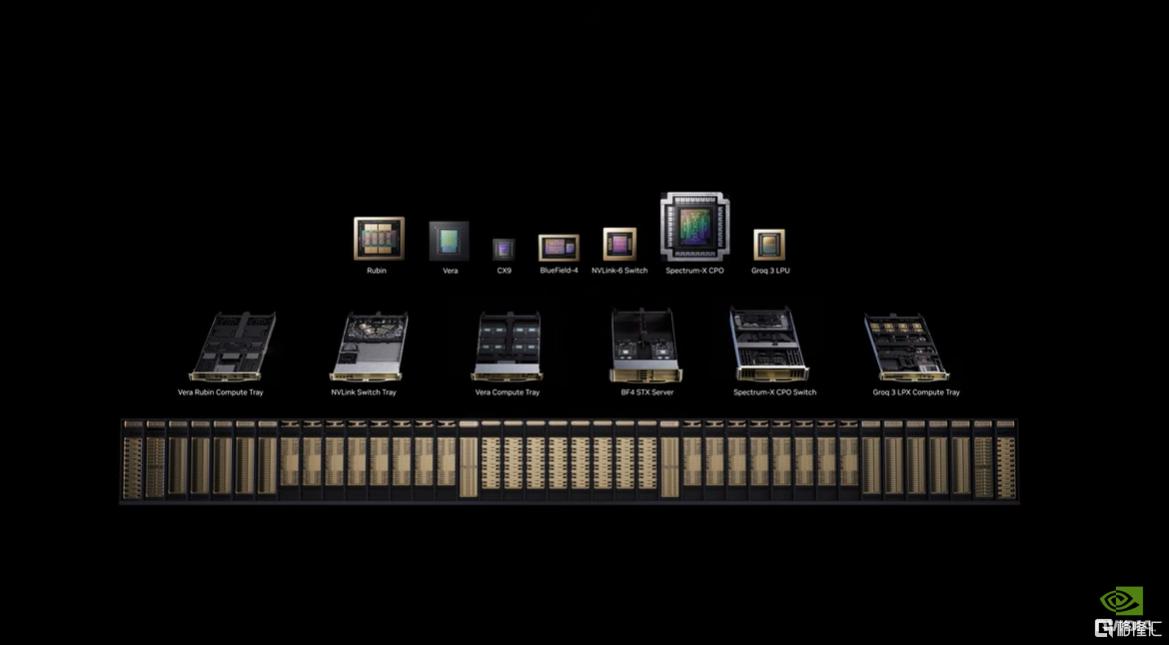

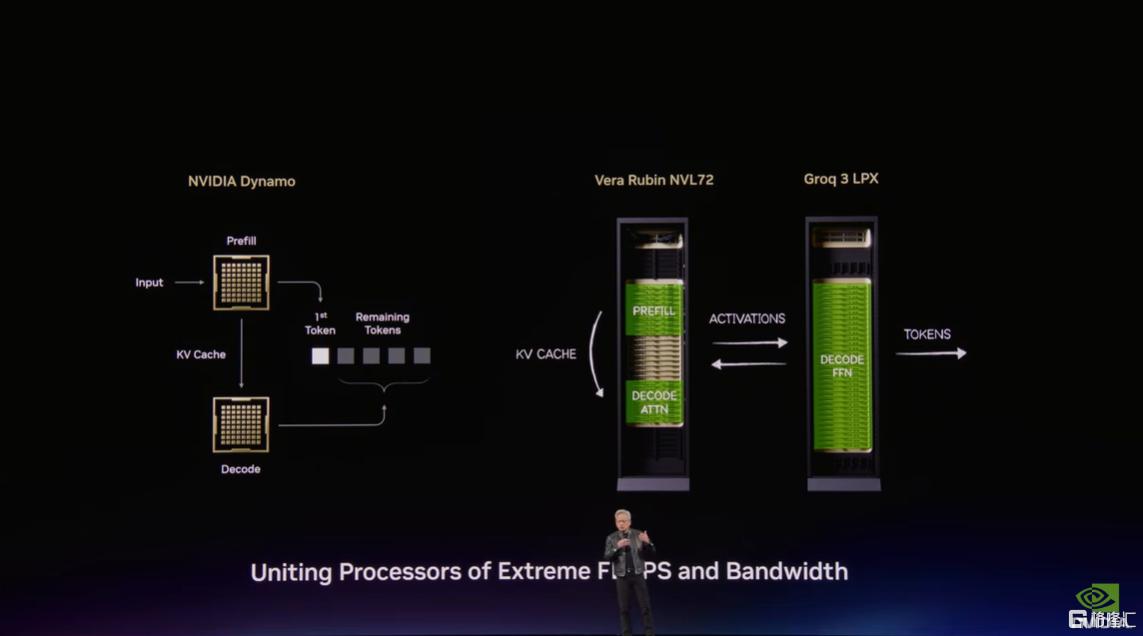

Vera Rubin架构与Groq融合

演讲中,黄仁勋揭晓了代号为Vera Rubin的下一代架构。

由Vera CPU(3nm工艺、88个定制核心)与ubin GPU(配备288GB HBM4e显存)组成的超级芯片平台,带来了重大变革:

100%液冷散热,支持45度热水冷却,大幅降低数据中心散热能耗;

全线缆消失,机架安装时间从两天缩短至两小时;

Vera Rubin平台每兆瓦吞吐量提升35倍,在最高价值服务场景中吞吐量提升10倍。

最重磅的突破在于整合了Groq团队的确定性流处理器技术,通过Dynamo软件 实现了“解耦推理”:

利用Rubin的海量内存处理复杂上下文,利用Groq芯片极速生成代币。

这一组合使吉瓦级工厂的代币生成速度实现了惊人的350倍跨越。

黄仁勋透露,首个Vera Rubin机架已在微软Azure上线运行。

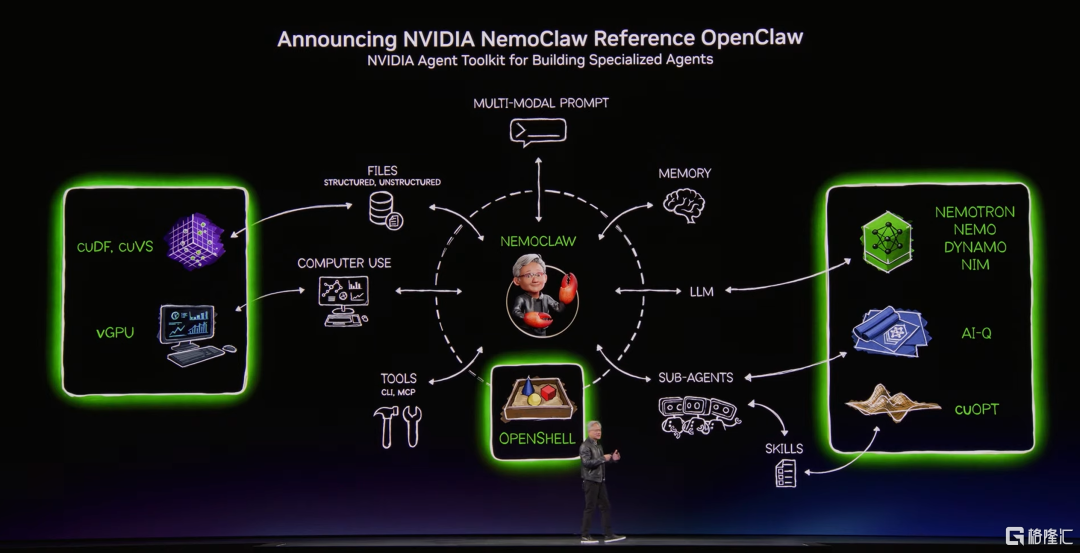

英伟达版OpenClaw上线

黄仁勋将开源项目OpenClaw定义为AI时代的Linux。

这是一个能让AI智能体自主调用工具、执行代码、管理文件系统的操作系统级框架。

“OpenClaw是人类历史上最受欢迎的开源项目。它在几周内就做到了Linux 30年才做到的事。”

“在OpenClaw出现之前,个人电脑因为Windows而成为可能,现在,OpenClaw让创建个人Agent成为可能。其含义是深远的。”黄仁勋指出。

不过,Agentic系统可以访问敏感信息、执行代码、与外部通信,这也带来了巨大的安全挑战。

为解决安全痛点,英伟达推出了极简养虾NemoClaw智能体平台,使用NVIDIA Agent Toolkit软件,只需一条命令即可优化 OpenClaw。

它安装OpenShell,提供开放模型和隔离的沙箱,为自主代理增加数据隐私和安全保障。

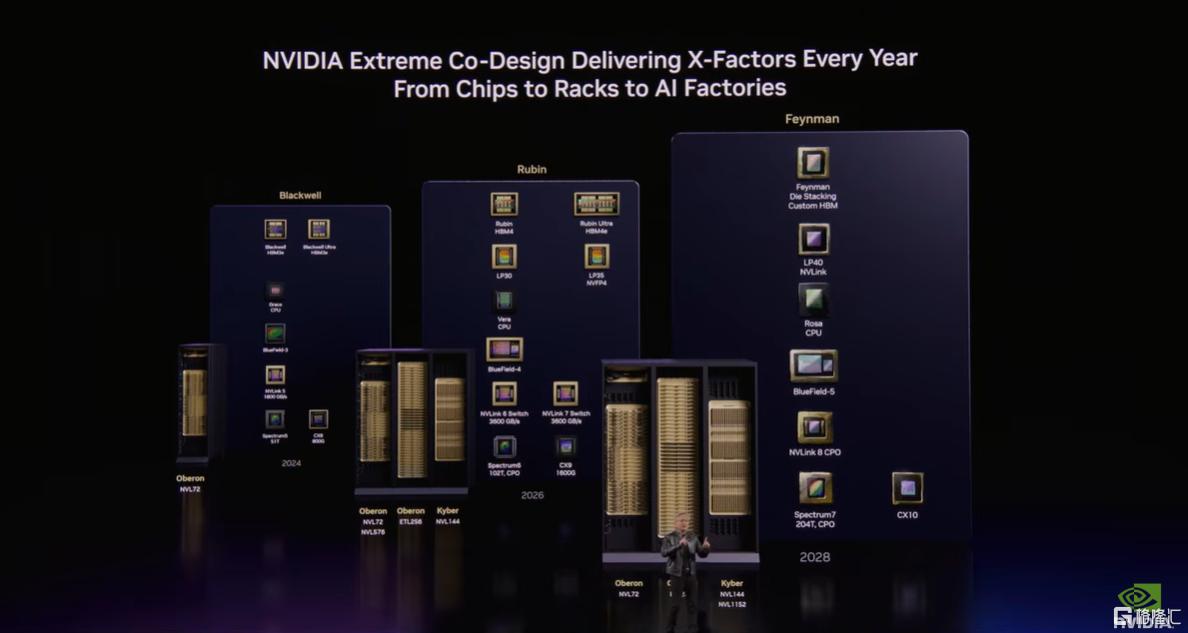

Feynman架构:1.6nm LPU深度集成

展望未来,黄仁勋披露了继Rubin之后的下一代GPU架构Feynman(费曼),搭载LP 40处理器和Rosa CPU,支持共封装光学(CPO)技术,将成为全球首款采用台积电1.6nm A16制程的AI芯片。

Feynman的核心突破主要在于——将LPU(语言处理单元)与GPU深度集成,专攻推理延迟和内存墙问题。

新一代LP 40芯片将融合英伟达的规模优势与Groq团队的工程能力,配合全新Rosa CPU ,构建更完整的推理计算体系。

生产预计2028年启动,2029年起向客户交付。

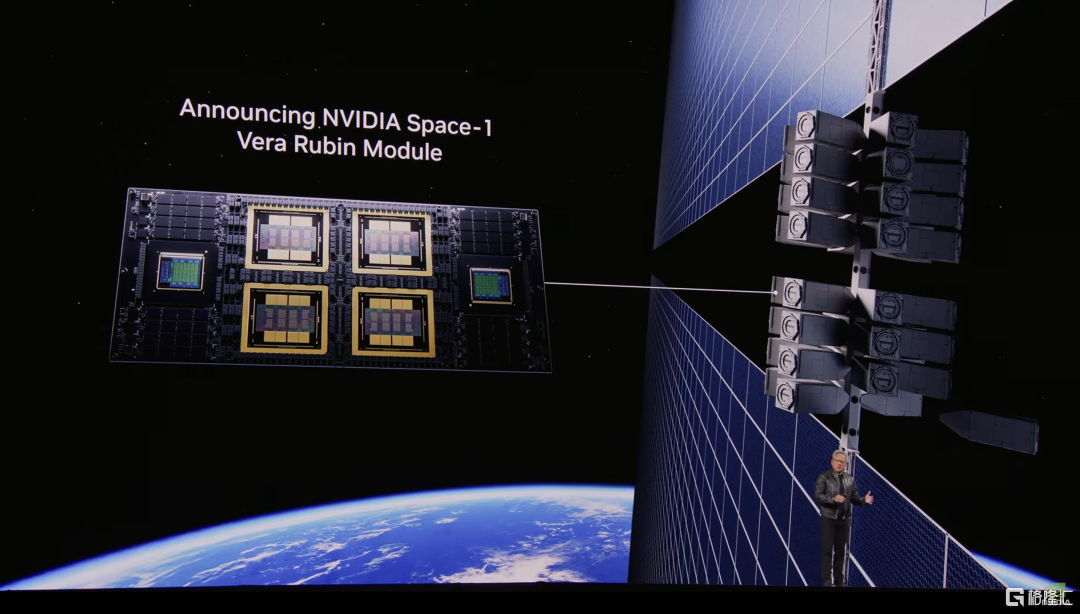

此外,英伟达宣布进军太空计算,正在研发名为Nvidia Vera Rubin Space-1的用于轨道数据中心的新型芯片/计算机。

“太空中没有传导,没有对流,只有辐射,我们必须想办法在太空中冷却这些系统,但我们有很多优秀的工程师正在研究这个问题。”